- RAG đã trải qua 6 giai đoạn tiến hóa - từ keyword search thủ công đến Agentic AI tự lên kế hoạch và tự sửa lỗi.

- Agentic RAG tốn 3-10x token và thêm 2-5x latency, nhưng đáng giá với các tác vụ multi-hop phức tạp, y tế, pháp lý.

- MCP trở thành chuẩn Linux Foundation tháng 12/2025 - báo hiệu RAG sắp biến thành tầng hạ tầng cốt lõi của mọi ứng dụng AI.

TL;DR

- RAG = LLM + bộ nhớ ngoài. Thay vì retraining tốn kém, bạn kết nối model với dữ liệu thực tế.

- 6 giai đoạn: Keyword → Semantic → Hybrid → LLM tích hợp → Naive RAG → Agentic RAG (hiện tại).

- Agentic RAG không còn chạy pipeline tuyến tính - nó tự lập kế hoạch, tự đánh giá, tự retry cho đến khi tự tin vào kết quả.

- Chi phí thực: 3-10x token, latency p50 tăng từ 1-2s lên 4-8s. Xứng đáng với domain phức tạp, không xứng đáng với FAQ bot.

- Stack 2026: LangGraph + BM25 + dense embeddings + Voyage AI reranker + Ragas evaluation.

RAG là gì - giải thích trong 60 giây

LLM biết rất nhiều - nhưng kiến thức bị đóng băng tại thời điểm training. Hỏi về sự kiện tháng trước? Dữ liệu nội bộ của công ty bạn? Model không biết.

RAG (Retrieval-Augmented Generation) giải quyết điều này bằng cách cho LLM một bộ nhớ ngoài có thể tìm kiếm. Khi bạn đặt câu hỏi, hệ thống:

- Retrieve - lấy đúng đoạn dữ liệu liên quan từ database

- Augment - nhét vào prompt cùng câu hỏi của bạn

- Generate - LLM trả lời dựa trên context thực tế đó

Kết quả: không cần retrain, dữ liệu luôn cập nhật, có thể cite nguồn. Đây là lý do RAG trở thành kiến trúc mặc định của hầu hết ứng dụng AI enterprise.

Con đường tiến hóa qua 6 giai đoạn

Giai đoạn 1 - Keyword Retrieval: Inverted index đơn giản. Tìm kiếm từ khóa không hiểu ngữ cảnh - "Python help" trả về cả hướng dẫn lập trình lẫn bài về nuôi rắn.

Giai đoạn 2 - Semantic Search: Văn bản được chuyển thành vector cao chiều. Model học được rằng "coffee" và "espresso" liên quan nhau dù không cùng từ khóa.

Giai đoạn 3 - Hybrid Retrieval: Kết hợp độ chính xác của keyword search với khả năng hiểu ngữ nghĩa của semantic search. Tốt nhất cả hai thế giới.

Giai đoạn 4 - LLM Integration: LLM bắt đầu tham gia, nhưng vẫn bị giới hạn bởi training data tĩnh. Bước đệm quan trọng.

Giai đoạn 5 - Naive/Simple RAG: Tài liệu được embed vào vector database. LLM truy vấn khi cần và trả lời dựa trên context thực. Cải thiện đáng kể nhưng pipeline còn tuyến tính và dễ gãy.

Giai đoạn 6 - Agentic RAG (2025-nay): Không còn là pipeline cố định. Agent tự quyết định khi nào cần retrieve, retrieve từ đâu, đánh giá kết quả có đủ tin cậy không, và retry nếu cần. Hoạt động như một nhóm chuyên gia tự kiểm tra chéo nhau.

Agentic RAG - bước nhảy lớn nhất từ trước đến nay

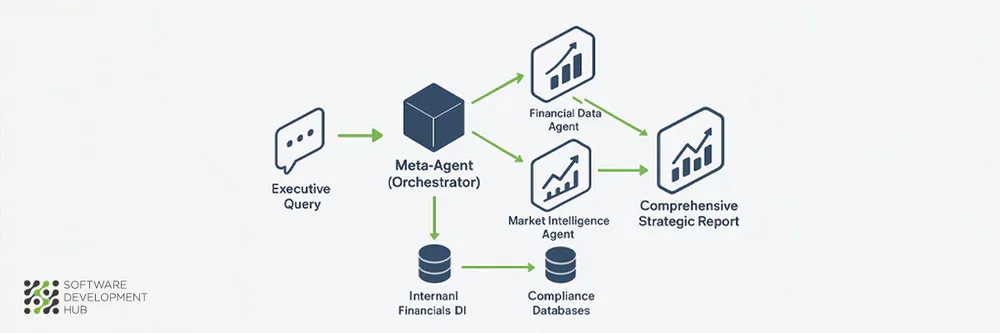

Agentic RAG nhúng AI agents vào pipeline RAG, tận dụng 4 design pattern cốt lõi: Reflection (tự đánh giá output), Planning (lập kế hoạch multi-step), Tool Use (gọi API, SQL, web), và Multi-agent Collaboration (nhiều agent phối hợp).

5 pattern phổ biến nhất trong production 2026:

- Self-RAG: Model tự emit "reflection token" quyết định có cần retrieve không và output có được hỗ trợ bởi nguồn không.

- CRAG (Corrective RAG): Đánh giá độ tin cậy của retrieval. Nếu thấp - tự động fallback sang web search hoặc trigger retry.

- Adaptive RAG: Classifier phân loại độ khó của query. Query đơn giản bỏ qua agent hoàn toàn - tiết kiệm token và latency.

- ReAct: Vòng lặp Reason-Act qua nhiều tool - vector DB, SQL, web search, MCP servers - cho đến khi đủ context.

- Multi-hop Decomposition: Câu hỏi phức tạp được tách thành các sub-query độc lập, chạy song song, tổng hợp lại.

Con số thực tế: Traditional vs Agentic

| Dimension | Traditional RAG | Agentic RAG |

|---|---|---|

| Latency p50 | 1-2 giây | 4-8 giây |

| Token multiplier | 1x | 3-10x |

| Retrieval calls/query | 1 | 2-6 |

| Chi phí (10K queries/ngày) | ~$500/ngày | $700-$5,000/ngày |

| Chi phí xây dựng | $8K-$25K (3-8 tuần) | $25K-$50K (8-16 tuần) |

Production targets đáng nhớ: Faithfulness ≥ 0.9, Answer relevancy ≥ 0.85, Context precision ≥ 0.8. Dưới ngưỡng này - hệ thống chưa production-ready.

Ai nên dùng Agentic RAG - và ai không nên

Xứng đáng với chi phí:

- So sánh hợp đồng pháp lý phức tạp qua nhiều tài liệu

- Hỗ trợ quyết định y tế/tài chính (high-stakes, cần accuracy cao)

- Multi-step research tổng hợp thông tin từ nhiều nguồn

- Query mơ hồ cần clarification trước khi retrieve

Traditional RAG vẫn tốt hơn:

- Customer service FAQ bot

- Tra cứu tài liệu sản phẩm

- Bất kỳ hệ thống nào yêu cầu latency < 3 giây

Tóm lại: "Agentic RAG tốn 3-10x token và thêm 2-5x latency. Nó xứng đáng với câu hỏi multi-hop, domain cao rủi ro - không xứng đáng với single-fact lookup."

Stack 2026 và hướng tiếp theo

Tech stack chuẩn trong production agentic RAG hiện tại:

- Orchestration: LangGraph (stateful control) hoặc LlamaIndex Workflows (retrieval-heavy)

- Retrieval: BM25 + dense embeddings → cross-encoder rerank → optional GraphRAG

- Embeddings:

text-embedding-3-large(general) hoặcvoyage-3(domain-critical) - Reranking: Voyage AI rerank-2.5 (dẫn đầu) hoặc Cohere Rerank v3.5

- Evaluation: Ragas (per-query metrics) + Arize Phoenix hoặc Langfuse (trajectory tracing)

Tháng 12/2025, Anthropic donate Model Context Protocol (MCP) cho Linux Foundation - OpenAI và Google cùng adopt. MCP đang trở thành giao thức chuẩn để agent tương tác với retrieval tools.

Nhìn về phía trước: RAG đang biến thành "Context Engine" - hạ tầng thống nhất phục vụ mọi nhu cầu context của LLM: kiến thức domain, mô tả tool, lịch sử hội thoại. Không còn là một pattern nữa - mà là nền tảng.

Nguồn: Frank's World of Data Science, arXiv 2501.09136 - Agentic RAG Survey, MarsDevs 2026 Production Guide, RAGFlow 2025 Review.